Sumber: Reuters | Editor: Yudho Winarto

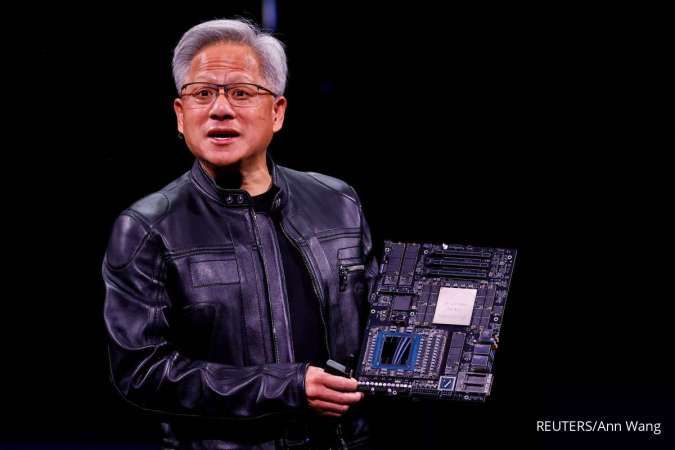

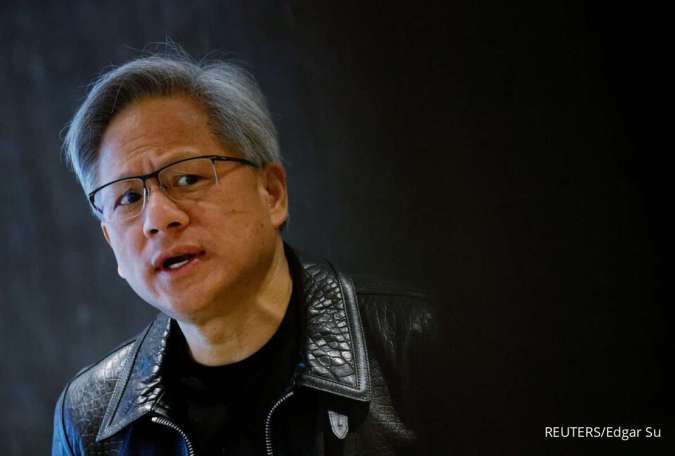

KONTAN.CO.ID - CEO Nvidia Jensen Huang mengatakan chip generasi terbaru perusahaan telah memasuki tahap produksi penuh dan mampu menghadirkan daya komputasi kecerdasan buatan (AI) hingga lima kali lebih besar dibandingkan generasi sebelumnya, khususnya untuk menjalankan chatbot dan aplikasi AI lainnya.

Pernyataan itu disampaikan Huang dalam pidatonya di ajang Consumer Electronics Show (CES) 2026 di Las Vegas, Senin (5/1/2026).

Ia juga mengungkapkan bahwa chip-chip terbaru tersebut akan mulai diluncurkan akhir tahun ini dan saat ini sudah diuji oleh sejumlah perusahaan AI di laboratorium Nvidia, di tengah meningkatnya persaingan baik dari rival tradisional maupun pelanggan Nvidia sendiri.

Baca Juga: Pasar Saham Bakal Anjlok pada 2026? Ini Peringatan The Fed untuk Investor

Platform baru bernama Vera Rubin yang terdiri dari enam chip Nvidia terpisah dijadwalkan debut tahun ini. Server unggulannya akan memuat 72 unit GPU Nvidia dan 36 CPU generasi terbaru.

Huang menunjukkan bagaimana sistem tersebut dapat dirangkai menjadi “pod” berisi lebih dari 1.000 chip Rubin, yang diklaim mampu meningkatkan efisiensi pembuatan “token” unit dasar pemrosesan AI hingga 10 kali lipat.

Untuk mencapai lonjakan kinerja tersebut, Nvidia menggunakan format data proprietari baru yang diharapkan dapat diadopsi secara luas oleh industri.

“Inilah cara kami menghadirkan lonjakan performa yang sangat besar, meski jumlah transistor hanya meningkat sekitar 1,6 kali,” ujar Huang.

Baca Juga: Soal Minyak Venezuela, Trump Siapkan Pertemuan dengan Exxon, Chevron, ConocoPhillips

Persaingan Kian Ketat

Meski Nvidia masih mendominasi pasar pelatihan model AI, persaingan jauh lebih ketat di segmen penyajian AI ke pengguna akhir, termasuk chatbot yang digunakan ratusan juta orang.

Di segmen ini, Nvidia menghadapi tekanan dari pesaing seperti Advanced Micro Devices (AMD) serta pelanggan besar seperti Google (Alphabet) yang mengembangkan chip AI sendiri.

Sebagian besar pidato Huang menyoroti keunggulan chip Rubin dalam menangani beban kerja tersebut, termasuk fitur “context memory storage”, teknologi penyimpanan baru yang dirancang agar chatbot dapat merespons pertanyaan panjang dan percakapan berkelanjutan dengan lebih cepat.

Nvidia juga memperkenalkan generasi baru switch jaringan dengan teknologi co-packaged optics, yang penting untuk menghubungkan ribuan mesin dalam satu sistem besar. Teknologi ini akan bersaing langsung dengan solusi dari Broadcom dan Cisco Systems.

Baca Juga: Intel Resmi Luncurkan Chip PC Generasi Baru Panther Lake di CES Las Vegas

Klien Besar Sudah Mengantre

Nvidia menyebut CoreWeave sebagai salah satu pengguna awal sistem Vera Rubin. Perusahaan juga memperkirakan Microsoft, Oracle, Amazon, dan Alphabet akan mengadopsi teknologi tersebut.

Selain chip, Huang menyoroti perangkat lunak baru untuk kendaraan otonom yang memungkinkan sistem AI membuat keputusan sekaligus meninggalkan jejak data bagi insinyur untuk evaluasi.

Nvidia juga akan merilis lebih luas perangkat lunak riset bernama Alpamayo, lengkap dengan data pelatihannya.

“Kami tidak hanya membuka kode model, tapi juga data pelatihannya. Hanya dengan cara itu kita bisa benar-benar mempercayai bagaimana model AI dibangun,” kata Huang.

Baca Juga: Maduro Mengaku Tidak Bersalah Atas Tuduhan Narkoba AS

Isu China dan Akuisisi Groq

Dalam sesi tanya jawab dengan analis, Huang menegaskan bahwa akuisisi talenta dan teknologi chip dari startup Groq tidak akan mengganggu bisnis inti Nvidia, namun berpotensi memperluas portofolio produk.

Di saat yang sama, Nvidia berupaya menunjukkan bahwa produk terbarunya melampaui chip lama seperti H200, yang masih diizinkan pemerintah AS untuk diekspor ke China.

Reuters sebelumnya melaporkan bahwa chip H200 sangat diminati di China, memicu kekhawatiran di kalangan politisi AS.

Huang mengakui permintaan H200 di China masih kuat. CFO Nvidia Colette Kress mengatakan perusahaan telah mengajukan izin ekspor chip tersebut, namun masih menunggu persetujuan dari pemerintah AS dan otoritas terkait lainnya.

/2025/12/23/1765465728.jpg)